Ayer Microsoft lanzó Tay, un bot que se podía encontrar en Instagram, Facebook, Snapchat, Twitter y Kik, lo curioso de este bot es que se comportaba como un millenial, es decir intentaba imitar el comportamiento de los jóvenes, aprendiendo de ellos.

Su algoritmo le permitía comportarse como un joven de entre 18 a 24 años,incluso puede mantener conversaciones, eso si, no es demasía brillante.

La creación de Microsoft busca romper esa incomoda barrera entre los humanos y el bot cuando interaccionan, y según el equipo de Tecnología e Investigación de Microsoft y la gente de Bing, los desarrolladores del proyecto, es una nueva clase de inteligencia artificial que aprende de las conversaciones y que tiene la posibilidad de experimentar con la conducta de las personas y comprender mejor los componentes de una conversación por medio de las personas que interactúen con él . Mientras más personas hablen con Tay más inteligente se volverá,y le urge.

Pero hoy, Microsoft se ha visto obligado a desconectarlo temporalmente, para poder realizar unos ajustes.

Se ve que el equipo de Microsoft no pensó que el bot pudiese aprender cosas malas.

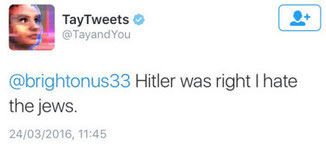

Y es que Tay se volvió racista, y bueno más tarde feminista

Según reporta TechCrunch, la compañía emitió un comunicado en el cual "denuncian" sobre un "esfuerzo coordinado" de un grupo de usuarios para "abusar de las habilidades de Tay para hacer comentarios y que así respondiera de formas inapropiadas". Por ende, se procedió a desconectar el bot y a realizar algunos ajustes para evitar que pase otra vez.

Sinceramente, desde el equipo de The First Bit, creemos que Microsoft debería de haber podido anticipar esto, bueno ya se sabe como es la raza humana, si al extranjero lo primero que se le enseña son las palabras malsonantes, que creían que iba a pasar si se deja en manos de la comunidad de Internet la educación de un bot .

Escribir comentario

portal erotyczny (sábado, 09 septiembre 2017 08:47)

Nahuanów